فهرست مطالب

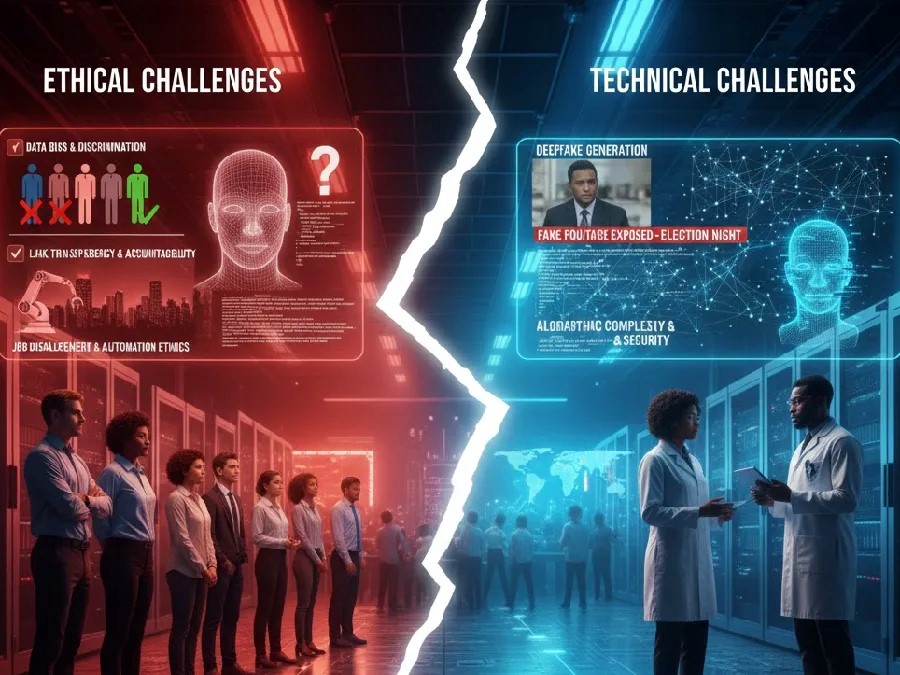

هوش مصنوعی به سرعت در حال تغییر دنیای ما است، از دستیارهای صوتی روی گوشی هایمان گرفته تا سیستم های پیچیده ای که در پزشکی و صنعت به کار می روند. اما این فناوری قدرتمند، مشکلات و سوالات بزرگی را هم با خود به همراه آورده است. بزرگ ترین چالش های هوش مصنوعی به دو دسته اصلی تقسیم می شوند: مشکلات اخلاقی و موانع فنی. در این مقاله به زبان ساده بررسی می کنیم که این چالش ها دقیقا چه هستند. موضوعاتی مانند حفظ حریم خصوصی، تبعیض توسط الگوریتم ها، از دست رفتن مشاغل و اینکه چه کسی مسئول اشتباهات هوش مصنوعی است را پوشش می دهیم. اگر می خواهید با نگاهی عمیق تر و کاربردی تر با این مفاهیم آشنا شوید، همیار آکادمی منابع آموزشی کاملی را برای درک بهتر این فناوری و مدیریت چالش های آن فراهم کرده است.

بخش بزرگی از چالش های هوش مصنوعی به نحوه استفاده از داده ها، تصمیم گیری الگوریتم ها و مسئولیت پذیری در قبال نتایج آن ها بازمی گردد. در ادامه به بررسی مهم ترین این موارد می پردازیم.

هوش مصنوعی برای یادگیری به حجم زیادی از اطلاعات نیاز دارد. این اطلاعات اغلب داده های شخصی ما هستند. جمع آوری و استفاده نادرست از این داده ها، یکی از جدی ترین چالش های هوش مصنوعی است. این مشکل در عمل به شکل های زیر بروز می کند:

راهکار: برای حل این مشکل، شرکت ها باید در مورد نحوه جمع آوری و استفاده از داده ها شفاف باشند و به کاربران کنترل بیشتری روی اطلاعات شخصی شان بدهند.

یکی از بزرگ ترین نگرانی ها این است که هوش مصنوعی، نابرابری های موجود در جامعه را بیشتر کند. الگوریتم ها بر اساس داده هایی آموزش می بینند که انسان ها تولید کرده اند و این داده ها پر از تعصبات جنسیتی، نژادی و اجتماعی هستند. این مشکل به شکل های زیر خود را نشان می دهد:

راهکار: راه مقابله با این مشکل، استفاده از داده های متنوع و بدون سوگیری و همچنین آزمایش مداوم الگوریتم ها برای شناسایی و حذف تعصبات است.

وقتی یک سیستم هوشمند اشتباه می کند، چه کسی مقصر است؟ این سوال یکی از پیچیده ترین چالش های هوش مصنوعی است. برای مثال، اگر یک خودروی خودران تصادف کند، مسئولیت با چه کسی است؟ ابهام در مسئولیت پذیری به موارد زیر مربوط می شود:

برای حل این مشکل، به قوانین و مقررات شفافی نیاز داریم که حدود مسئولیت هر بخش را مشخص کند.

بسیاری از الگوریتم های پیشرفته هوش مصنوعی مانند یک جعبه سیاه عمل می کنند. یعنی ورودی را دریافت و خروجی را تحویل می دهند، اما فرآیند تصمیم گیری آن ها برای انسان قابل درک نیست. مشکل جعبه سیاه بودن در این موارد اهمیت پیدا می کند:

راهکار: توسعه هوش مصنوعی قابل توضیح (Explainable AI) تلاشی است برای باز کردن این جعبه سیاه تا تصمیمات الگوریتم ها قابل فهم شوند.

ورود هوش مصنوعی به بازار کار و جامعه، تغییرات بزرگی ایجاد کرده است که همه آن ها مثبت نیستند. این فناوری پتانسیل تشدید نابرابری های اجتماعی و اقتصادی را دارد. مهم ترین تاثیرات عبارت اند از:

راهکار: برای مدیریت این تاثیرات، سرمایه گذاری در آموزش مهارت های جدید و ایجاد شبکه های حمایتی برای افرادی که شغل خود را از دست می دهند، ضروری است.

یک سیستم هوش مصنوعی قدرتمند اگر به درستی طراحی نشود یا مورد سوءاستفاده قرار گیرد، خطرات جدی ایجاد می کند. این موضوع یکی دیگر از چالش های هوش مصنوعی در بخش فنی است. این خطرات شامل موارد زیر است:

راهکار: توسعه پروتکل های ایمنی سخت گیرانه و نظارت دقیق بر کاربردهای حساس هوش مصنوعی برای جلوی این خطرات را گرفتن، مهم است.

جمع بندی

هوش مصنوعی مانند قطاری پرسرعت است که دنیا را به جلو می برد. اما این قطار به ترمزهای اخلاقی و فنی قدرتمندی نیاز دارد تا از مسیر خارج نشود. چالش هایی مانند حفظ حریم خصوصی، تبعیض، مسئولیت پذیری و ایمنی، موانعی جدی بر سر راه پیشرفت ایمن این فناوری هستند.

برای بهره برداری درست از هوش مصنوعی و کاهش خطرات آن، همکاری میان توسعه دهندگان، قانون گذاران و مردم ضروری است. آموزش و آگاهی رسانی در این زمینه نقش اصلی را ایفا می کند.

اگر به یادگیری بیشتر در زمینه هوش مصنوعی و مدیریت چالش های هوش مصنوعی علاقه دارید، دوره های تخصصی همیار آکادمی بهترین نقطه شروع برای شماست تا دانش خود را به روز کرده و برای آینده آماده شوید.

هیچ دیدگاهی ثبت نشده است.